AIディープフェイク氾濫の年、真実を守るテクノロジーとコラボの現状【情報インテグリティ】

偽・誤情報の拡散は選挙にも影響を与えています。対策としてのファクトチェックやテクノロジー活用はどこまで広がっているのか。日本ファクトチェックセンター(JFC)と電通総研が4月2日に共催した情報インテグリティシンポジウムで議論しました。

パネル討論「選挙とAIとファクトチェック:ディープフェイクへの対抗策」に登壇したのは、ファクトチェック団体、新聞社、研究者、シビックテックという異なる業界で偽情報対策に取り組む担当者。情報環境の現状から今後まで、それぞれの立場で語っています。

※シンポの議論を文字起こししたものですが、読みやすさを考慮して一部修正を加えています。

登壇者

モデレーター:古田 大輔(日本ファクトチェックセンター編集長)

工藤 淳氏(読売新聞 政治部デスク)

陣内 一樹氏(一般社団法人コード・フォー・ジャパン 副代表理事)

越前 功氏(国立情報学研究所 情報社会相関研究系 研究主幹・教授)

読売新聞が始めたファクトチェックのコラボ

工藤:昨年8月からファクトチェックの担当をしています。

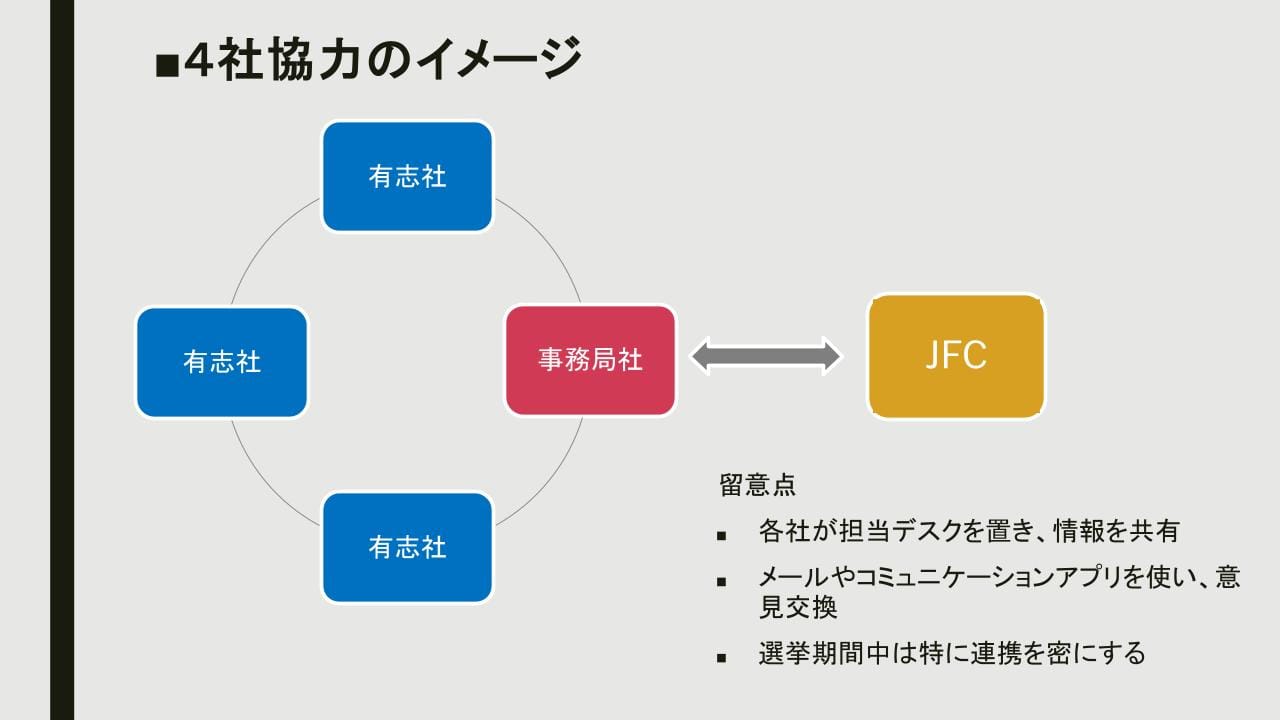

新聞社やテレビ局としてもSNSの大きな影響を無視できなくなってきたことを受けまして、昨年6月から時事通信さん、佐賀新聞さん、日本テレビさんとの4社共同の取り組みとして、選挙に関するファクトチェックを実施するようになりました。

今年の衆院選でも、4社で連携し、4つの案件でファクトチェックをした実績があります。

古田:今後、読売新聞さん、その他の新聞社やテレビ局でファクトチェックがどんどん増えていくとお考えでしょうか。

それとも、僕が先ほどいくつか構造的な問題を示しましたけれど、そんなに増えるということはなさそうか、どのように見ていらっしゃるでしょう。

工藤:一気に増えるというのは、古田さんがご指摘いただいた通り、マンパワーの問題であるとか、紙面・放送時間の問題でなかなか難しい部分はあります。ただ、他社と話をしたり、社内を見たりしていても関心は高まっていると思います。

今後も人員配置を工夫するなどして、少しずつ増えていくのかなとは考えています。

コード・フォー・ジャパンの「シビックテック」

陣内:コード・フォー・ジャパンは、シビックテックという市民がテクノロジーを活用して社会課題を解決する活動をしております。社会活動の例で言うと、コロナや環境というようなテーマも取り扱っております。その中の一つとして、偽・誤情報をここ3年ぐらい取り扱って、継続的なツール開発をしています。

なぜ、私たちが偽・誤情報を取り上げることになったかと言うと、私どもは台湾や韓国のシビックテックコミュニティと非常に仲が良くて、年に1回、「フェイシング・ジ・オーシャン」というイベントで会っています。去年だと台湾で、今年は韓国で予定しているんですけれど、そういった中でお互いテーマを持ち寄って意見交換をしたり、一緒に活動したりしています。

偽・誤情報に関して、特に台湾が活動しているということを聞いて、日本でも大きな問題になっていくかなというところで開発を始めました。ツール開発をする中で報道機関や研究者の皆さんと連携しながら進めていくアプローチをしております。

古田:私も台湾の人たちとはよく連携をして、一緒にファクトチェックをすることもありますし、日常的に情報交換をしています。シビックテックと呼ばれるような民間エンジニアの方々のこの問題への熱量で言うと、台湾と日本はどういう違いを感じますか。

陣内:全然違います。台湾・韓国に限らず海外の方とお話しすることが多いんですけれど、台湾は企業じゃなくて、非営利でテクノロジーを活用して活動している団体は複数あります。日本だとほぼうちしかいないので、海外から何かやってるところないかという相談は、大体うちに来ます。こういう活動をする組織を増やしていく必要性は非常に感じるところです。

古田:ファクトチェックに関しては、JFCに世界中から引き合いが来ます。対応するのが難しいぐらい。そのテクノロジー版がコード・フォー・ジャパンになっているんでしょうね。

陣内:コミュニケーションだけでもそれなりに大変です。専任じゃないですし、偽・誤情報対策だけやってるというわけではないので。昨年は、カナダ大使館と一緒にイベントをさせていただきました。ヒアリングの協力とかは、できるだけさせていただく形にしています。

古田:この分野は色々なコラボレーションを広げていかないといけないと思っている人がすごく多くて。世界の人たちも自分たちの知見を共有するのにすごく積極的ですよね。そういったネットワークに日本がより深く関わっていくということが重要だと思います。

国立情報学研究所のAI検知技術

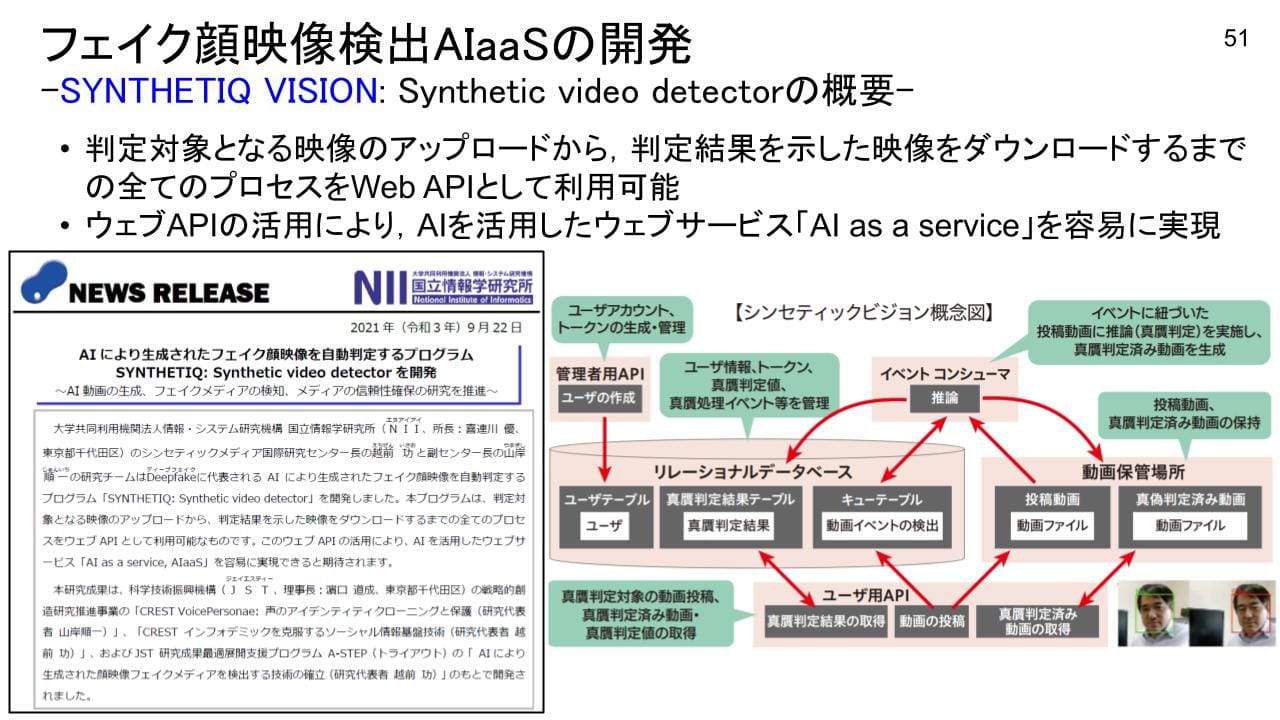

越前:私は2007年に企業の研究所から国立情報学研究所におりまして、マルチメディアとセキュリティ、特に生体情報をどう保護するかを研究してきました。そこから本物と見紛う生体情報を生成するディープフェイクが出てきて、その対策にシフトしたところです。

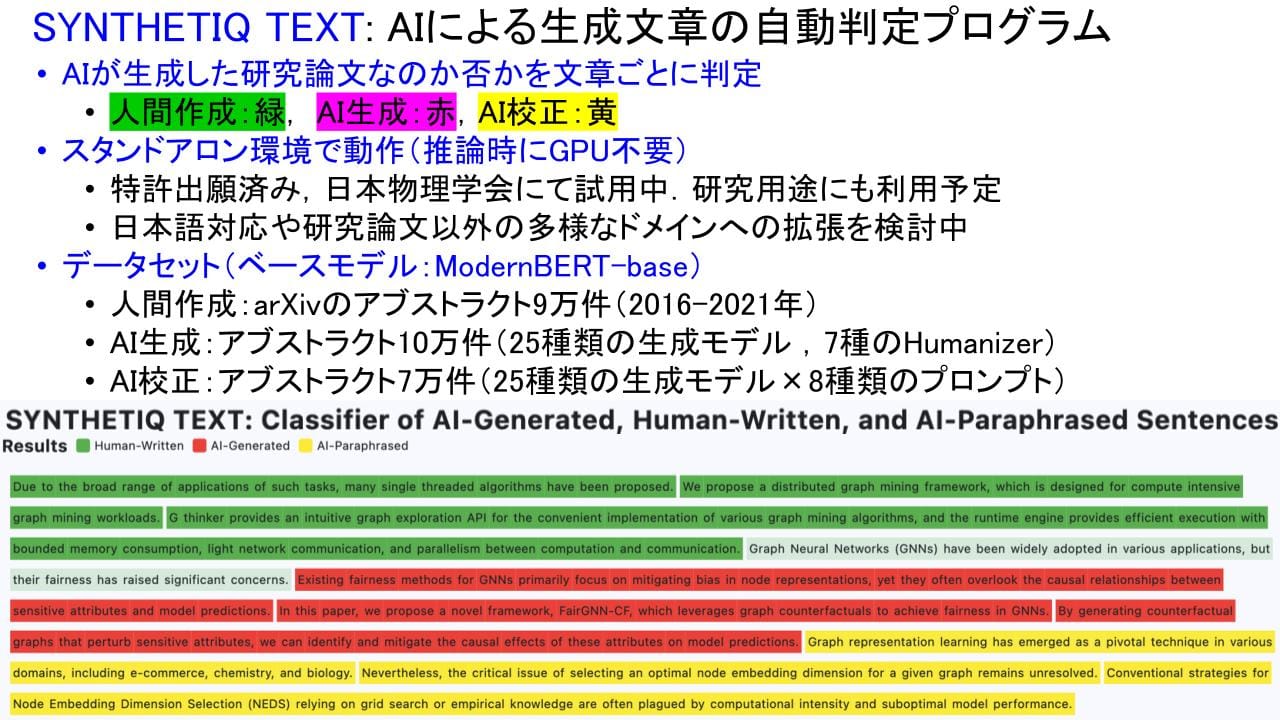

スライドを見ていただきますと、私たちの研究グループは、2021年にディープフェイク、フェイク顔映像を検知するプログラム「SYNTHETIQ VISION」を開発しまして、複数の公的機関、企業で実際に使われている状況でございます。

もう一つは、最近発表したテキスト版。具体的には、文章ごとに生成AI製か、人間が作ったのか、さらに人間が生成してAIが校正したのかを文章ごとに見極めてくれるプログラム(SYNTHETIQ TEXT)です。

これはクラウドを使わず、ノートパソコンだけで動くのがポイントです。まずは学術論文を対象に開発しましたが、NHKにも取り上げられまして結構バズってます。「こんなのいるのか」とか。研究者だったら生成AIで論文書くのは当たり前だろうと言われまして。一方で、論文執筆を生成AIに任せきりにしてチェックを怠ることで、存在しない参考文献や科学的に正しくない論述などといったハルシネーションが生じているのも事実です。このような黎明期において、様々な組織がこのプログラムをお試しとして使っていただければありがたいと思います。

「AI氾濫」と対抗策としてのAIの限界

古田:まず越前さんへの質問です。すでに「AI氾濫」とでも呼ぶべき状況で、人間によるチェックでは歯が立たない。昔から歯が立たなかったんですけれど、それが質的にも量的にも、とんでもないレベルになったわけです。もうテクノロジーにやってもらうしかない。

同時にテクノロジーの課題もあります。つい最近、ネタニヤフ首相はすでに死んでいるという情報が流れて、それに対してイスラエル政府が「生きてますよ」とネタニヤフ首相の動画を流した。「これは偽物ではないか」と疑った人が、Hiveという誰でも無料で使えるAIツールで検証したら「96.9% AI」という結果が出て、それを証拠に「やはり、ネタニヤフは死んでいた」という情報がさらに拡散した。

このようなテクノロジーによる検証の限界、それが嘘を広げてしまうことすら起こりうる。これはどうにかなるもんなんでしょうか。

越前:技術開発をしていて、一番大変なのは最新のフェイクに追いつくことです。「ファインチューニング」と言って、新たなフェイクが出てきた時にどんどん追加学習しなければいけない。一方で、世に出ているツールのあらゆるモデルがそこに追随しているわけでもないんです。Hiveさんのモデルは、最新のものに対応していなくて誤検出、誤判断してしまったかもしれない。

技術がちゃんとしてても、末端まで最新の真贋判定モデルが行き渡るかどうかがポイントで、難しい問題になってます。ある程度、枠組みも保証しながら進めていけば精度は上がってくると思うんですけれど、技術だけ作っても最新のモデルが十分に行き渡らないというところが問題。そういった課題についてモデルの提供側とベンダー・クライアントが密に連携することで、ある程度リスクが防げるんじゃないかと思っております。

技術の普及とコストの問題

古田:テクノロジー的にもいたちごっこしないといけないし、どう普及させるのかも問題。それで言うと、開発にはお金がかかるし、Hiveみたいに「無料で使って」と開放するのもなかなか難しい。どうすれば開発改善にお金をかけつつ、それを広く行き渡らせることができるんでしょうか。

越前:最近韓国でも、政府がコンペを開いて精度の高い5つぐらいの真贋判定モデルを選んでネットの検証に使うみたいなことをやっています。国がある程度主導していただけると、我々の技術や他のベンダーさんが作った技術を使いやすくなると思います。

先ほども申しましたが、精度の高い真贋判定モデルを採用したから終わりではなくて、そこからが重要です。真贋判定モデルの継続的なアップデートをし、アップデートしたモデルに迅速にリプレースしていただけるか。コストはそれほど高くないんです。

生成AIモデルを構築するのはコストかかるんですけれど、真贋判定モデルの構築はそれほど高くない。そういったところも踏まえて制度設計していただけると、かなり広まっていくんじゃないかと思っております。

報道現場でのテクノロジー活用

古田:読売新聞で実際ファクトチェックに取り組まれた工藤さんに伺ってみたいんですけれど、どこに困りましたか。今みたいな、人間の目では判断できない事例もあったと思うんですけれど。今回の選挙で言うと、AIで作られた高市さんを熱烈に応援する高齢者の映像、中道の選挙広報動画が捏造されるとか、改変されるとか。テクノロジーが必要とされる検証に、今読売新聞さんはどのようにキャッチアップしていこうとしているんでしょうか。

工藤:そこはなかなか難しいところです。弊社で言うと、政治部や社会部が共同してファクトチェックをしているんですけれど、その辺は社会部にSNSを専門にしているところがありますので、そういったテクノロジーも使いながら判定はしていこうというのはあります。

それでも本当にそれをファクトチェックとして責任を持ってできるのかというと、なかなか難しい。なので、動画を一部だけ切り取って意味を変えるようなものを取り扱うことが増えてしまっています。テクノロジーが発展するに従って、取り組みとしてもそちらの方向に移さなければいけないという問題意識はあります。今後、どうキャッチアップしていくかが課題ですね。

古田:その中で、先ほど越前さんがまさに指摘されたような、ちゃんとそれを取り入れる、しかもそれを改善させるような、実はそこまでお金かからないんだからっていうところで予算確保できるのかというところが各社判断になってくるかと思うんですけれど。実際そういうツールを採用していこうという検討は進んでいるんでしょうか。

工藤:SNS班などで少しずつ導入していると聞いていますし、検討は進んでいます。

古田:最近ではSakana AIと協力して、中国からの影響工作がどのように広がっているか分析していましたね。自分たちでツールを取り入れるだけでなく、コラボレーションも広げる方向性なんでしょうか。

工藤:そうですね。そこは積極的にやっていこうという話になってますね。

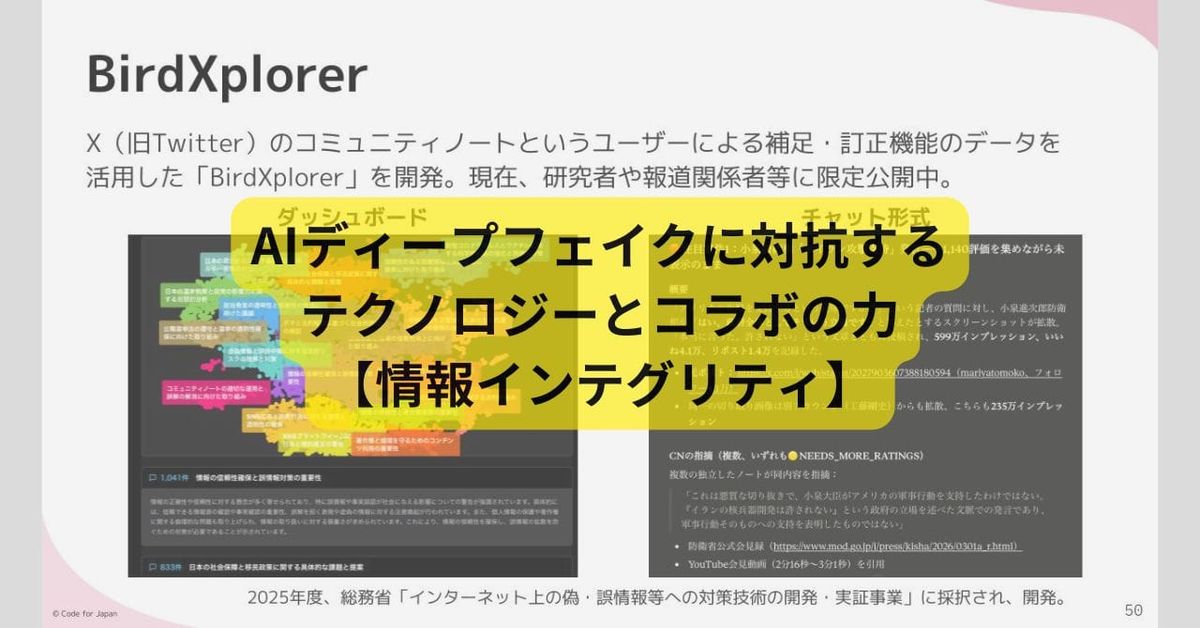

コミュニティノートの可視化:BirdXplorer

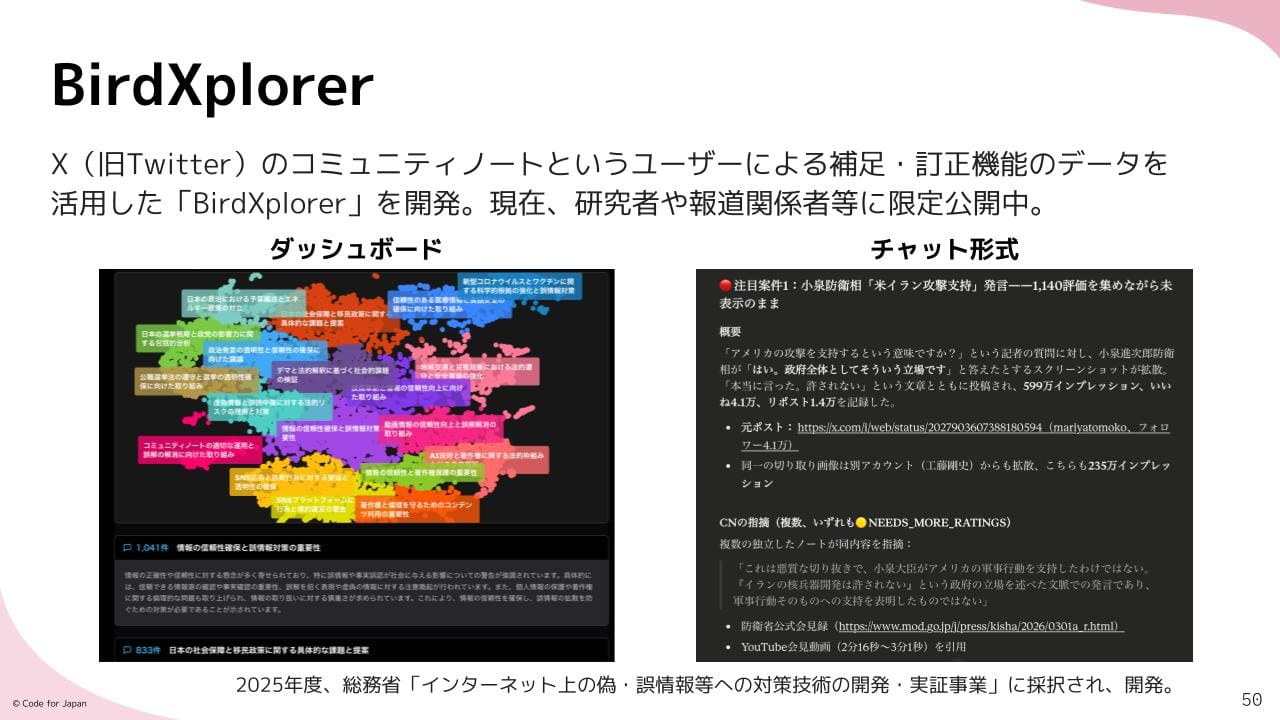

古田:テクノロジーと言っても全く違うアプローチをしているコード・フォー・ジャパンの「BirdXplorer」の説明も陣内さんからいただけたらと思います。

陣内:Xにコミュニティノートという、ユーザーによる補足・訂正機能があります。必要な時は他のユーザーが補足の文章を書いて、別のユーザーが評価していくことによって、評価が高ければ一般ユーザーにも見られる機能になっております。

ユーザーが書いたコミュニティノートは、データとして全て公開されておりますので、私どもはそれに着目して、BirdXplorerというツールで「コミュニティノートの可視化」に取り組んでおります。いくつか機能があるんですけれど、ダッシュボードとしてまず表示しているのが、左がナラティブ分布。すでに億とか10億の単位でノートが溜まっております。

その中で、例えば、この1ヶ月間の日本語で区切ると、どのようなナラティブ(語り口)が発生したのか。さきほど、古田さんの発表で「ニュースガードが1日2件のナラティブを確認」みたいな紹介がありましたけれど、一つ一つを追っていくのは量的にはしんどい。どういったナラティブがあるのかを可視化して、さらにブレイクダウンしていける機能になっております。

右が、まだ試作品段階なんですけれど、ClaudeというAIを使っているんですけれど、コミュニティノートのデータをClaudeに読み込ませて回答する機能です。

例えばイラン戦争について「イランへの攻撃でどういうコミュニティノートがあるんですか」ということをチャット形式で聞くと「こういうコミュニティノートがあります。こういう評価がされています」だとか「インプレッションはこれだけあります。具体的にはこのURLです」みたいなところを読み込みに行ってくれます。

傾向として知りたい時は、ざっくりと質問をすればいいですし、個別のことを深く掘っていきたいという時はURLまで聞いていく。記者や専門家だったら具体的な内容を実際見て探すということもできる機能を開発しております。

XのAPI変更とデータ取得の課題

古田:越前さんに紹介いただいた「SYNTHETIQ Vision」みたいに、検証対象がAIが作ったものか判定を出してくれるのは非常に参考になります。

一方で「BirdXplorer」みたいなものは、真偽判定をしてくれるわけではないけれど、例えば、どの偽情報を優先的に検証すべきであるかとか、人々のものの見方がどういう投稿によってどう変化しているかみたいなことを知ることができる。こういう「ナラティブ分析」が非常に重要になってきています。

日本ファクトチェックセンターが加盟している国際ファクトチェックネットワーク(IFCN)でも長年議論されているのは「個々の偽情報・誤情報だけをファクトチェックしていてもダメ」ということです。それだけだと焼け石に水。全体として偽情報・誤情報が人々の物事の見方にどのような影響を与えているのかを理解しながら対策を施していく必要があります。そういった時に、このツールは非常に便利です。

それと、BirdXplorerが素晴らしいと思ったのは、XのAPIの変更でデータ分析に膨大なお金がかかるようになったのが、このアプローチはその対策にもなっていますね。

陣内:そうですね。Xにはもともとアカデミックプランという研究者向けのプランがあって、かなりのデータを無料で使えたんですね。そのAPIは非常によく使われて、研究もされていました。

それが2年ほど前に急にプラン自体がなくなって、一般向けを使えということになった。そうするとデータを取るのには、最低月額5000ドル必要です。エンタープライズ向けだと数百万円というレベル。結局、研究者も報道機関も使えない状態になってしまいました。

私たちがコミュニティノートに着目したのは、それがファクトチェック的な機能を果たしているというのもありますけれど、無料だという点です。このコミュニティノートのデータを使い、ノートに紐付いているところだけAPIで取りに行く。必要なところだけだったら、リーズナブルな金額でデータを取得できるというのが特徴になってます。

古田:プラットフォームがより積極的にデータを公開することは重要です。欧州であればそれが法律として課されている。データの透明性や公開性に着目するのも非常に重要なポイントだと思っております。

AIエージェントと「帝国」

古田:残りが20分で、最後の5分はお一人ずつ1〜2分で話していただこうと思います。その前に、今の状況を改善するために何をやっていきたいか、社会の進むべき方向性について、今度は越前さんから順番にお願いします。

越前:ソーシャルメディア上の偽・誤情報の拡散はさらに高度化している状況です。他国や様々な組織がAIエージェントを動かして、ソーシャルメディア上に都合の良い言質をあたかもトレンドのように表示して多くのユーザに視聴させるという攻撃が出てくる。それに対して色々な対策も行われているわけです。

今後さらにAIの技術進化が進むと、AIが人の認知に踏み込んでいくんじゃないかと思うんです。一つは人間とAIがディープな対話を始めたというのは皆様ご存知と思いますけれど、AIと結婚するとかAIに悩み相談とか。これがエージェンティックになったらどうなるか。個々人の嗜好を学習した多数のAIが人に寄り添うふりをして、協調動作をすることで、金銭を搾取したり、ある特定の思考に誘導したり、宗教に勧誘したり。

一旦、信頼関係が生まれてしまうと、人の心って動きやすい。そういったところがエージェンティックに動いた時にどうなるかを私は一番気にしてます。対策として、もう一人の公平なAIが「それはちょっと違うんじゃないか」と言ってくれるとか。AIモデルは認証制にして「このAIとは付き合っていいけれど、このAIとは付き合わないわよ」とか。「このAIとだけは付き合いなさいよ」とかですね。シニアも含めて。そういった制度も大事だと思います。

こうした技術開発と制度設計まで関われれば、今後さらに潜在的な脅威に対しても対応できるんじゃないかと思っております。一研究者としての意見です。

古田:越前さんも含む研究者の方々や我々ファクトチェッカーは何年も前から「AIディープフェイクが氾濫しますよ、どうするんですか」と警鐘を鳴らし、私たちはファクトチェックの切り口で、越前さんたちはテクノロジーの切り口で対策を考えてきました。そして、実際に2026年が氾濫の年になりました。

AIエージェントが今後自律的に動いて情報環境をかき乱すというのも、起こる起こらないの話ではなく、いつそれが現実のものになるかという話です。2026年後半にはそうなっているかもしれない。しかし、社会的な対策はどうしても今の状況をもとに議論し、法律になるのが翌年以降というスピード感なので、どうしてもギャップがある。

越前:研究者が色々なところに訴えていく、政府関係者に説明していくところは非常に大事だと思います。日本は柔軟なところもありますので、実は偽・誤情報の予算は各省庁に早くついた方なんですよね。そういったところに訴えていくことで早めの制度設計ができれば、非常に意義があると思っております。

継続性の確保と統一地方選への対応

陣内:BirdXplorerでいうと、報道機関、研究者、大学の授業とかでも使っていきたいというのがこの1年です。将来でいうと、LLMの影響、特にAIを通じて情報を取っていく点についてです。

Google検索はいまでは「AI Overview」が一番上にあって、AIが書いた文章を見ています。そして、Grokにファクトチェックを頼むという、世界がどんどん深くなるし広がっていく。

英語圏ではLLMがちゃんと情報を取ってきているのか研究されています。その中で、ロシアはLLMが読み込むためのプロパガンダサイトを数万ページ作って、LLMが誤認した回答をするように導いているんじゃないかみたいな話がある。では、日本語の情報空間はどうなんだと調査しているところです。

海外だと、GeminiとかClaudeとかファクトチェックの情報を参照しているんですけれど、OpenAIはあまり取ってこないという傾向があったりします。日本では、今のところ私たちが知る範囲ではファクトチェックをあまり持ってこない。LLMを通じた情報空間が日本語で機能していくように分析をしていきたいと思っています。

古田:日本の情報環境を考えた時に、他言語の情報環境も考えなくてはいけない状況になっていると思います。ロシア語環境もそうですし、中国語環境で日本に関する情報がどう流れているのか。それがLLMに影響を与えてくるので。今日私たちが出したファクトチェックの記事でもですね、高市首相が訪米した時に長崎に原爆を落としたパイロットの墓に献花したっていう花を捧げたという情報の検証でした。

元ネタはロシアのニュースメディアがそういうの流してる。高市首相はアーリントンの無名戦士の墓には献花しましたけれど、長崎に原爆を落としたパイロットに献花したわけではない。でもロシアのニュースメディアが書き、拡散することによってAIは学習する。他の海外メディアも同じようなニュースを出していました。もしかしたらAIで調べて、そう出てきてしまったのかもしれない。そんなところまで私たちが考えていく必要があります。

ここでも陣内さんに聞きたいんですが、私たち、お金がないじゃないですか。BirdXplorerみたいなことをやるのも、お金がない中でどうやろうか考える。私たちの様な団体の規模の小ささは、日本におけるボトルネックだと思います。

陣内:イニシャルとランニングの費用は分けて考えた方がいいと思っています。私たち3年間活動しているうちの最初の2年間は完全に自前で、持ち出し的にやっていました。昨年度は運よく総務省さんに支援いただいて、基盤をなんとか開発している。今は限定公開という形ですけれど、ランニングのフェーズになったらお金はかなり抑えられるようになる。ここは寄付モデルでやっていこうと思ってます。

ただ、次をやる時はやっぱりイニシャルをどうするんだという話は絶対に出てきます。以前に比べると海外からの助成金も取りにくい状況は明確にある。今回は総務省さんに支援いただきましたけれど、そのような形がいいのか他の形があるのか、かなり考えないといけない。

寄付モデルでいくらぐらいまでだったら行けるのか。本当はベターな形は法人向けにやっていくビジネスモデルですが、ファクトチェック以外の形で模索するのは考えないといけない。普通の民間ビジネスに近い形で維持していくのは考えないといけないと思っております。

古田:資金問題は本当に深刻です。台湾の団体の方々も、実は欧米の財団などにかなり資金提供を受けていたんです。それがトランプ政権になって一気にメタなどが支援のお金を絞ったことによって、残ったところの資金の取り合いになっています。数年のうちに、ファクトチェックとかメディアリテラシーで活躍していた団体のいくつかが活動停止に追い込まれそうな状況になってきています。

今触れていただいた総務省のプロジェクトは、それによって開発を進めることができたというところもある。この後に登場してもらうクラスルームアドベンチャーもそうです。先日、成果発表のイベントがあって、私も取材に行きました。14団体の方々が成果発表をしていた。話題の一つがこの後のランニング費用なんです。

なんで、総務省が支援しないといけないか。「お金がかかるけれど売り物になるかわからないから」です。売り物になるなら自分たちで開発します。売り物になるかわからないから総務省が支援しないといけない。でも、総務省の支援が終わった後、ランニング費用どうするんですかという話をしたら「厳しい」という声が出てくる。14団体の中で残るものもある。「BirdXplorer」にはもちろん残っていただきたいですし。だけど、残らないものもあるという厳しい状況と思います。

新聞社間の連携と読者の信頼

工藤:今後の前に、課題に感じていることがあります。例えば、検証対象の選定の難しさ。どう解消していくかは、ファクトチェックの手法とか、ツールを導入するとか、そういったところで日々上げていかなければいけない。

4社の取り組みで言うと、ある政党に批判的な投稿を扱った時に、「不偏不党」にこだわるところもあるものですから、4社で協議した上で、ある社から提案があったんですけれど「それは選挙結果に影響するんじゃないか」という懸念が数社から示されたことによってやらなかった。

そういったところをどこまで取り扱えて、選定をどう進めていくか、4社で話し合っていると、どうしても時間がかかってしまう。SNSは動きが早いですから、議論していると1日2日経って、次の話題に移ってしまう。そこをどう瞬発的にやっていくかは、非常に課題に感じているというのが一つあります。あとはマンパワー的な問題であるとか。

今後に関して言うと、次の節目は統一地方選と考えています。統一地方選とか知事選は全国的な関心がどうしても落ちてしまって、ファクトチェックがなかなか進まない。誤情報は拡散するんじゃないかという懸念も4社で話し、読売新聞以外にも佐賀新聞さんのように地方紙の方も入ってくれているので、そういった視点も活かしてやっていけたらいいかなと思います。

あとは社内的な話ですけれど、部と部の垣根もなくし、人員も増強して取り組んでいけたらと考えております。

古田:統一地方選の話が出ましたが、国政選挙だと2週間ぐらいの余裕がある。それが市町村レベルになると1週間。この短期間でどうファクトチェックの対応を考えていらっしゃるでしょうか。

工藤:それは非常に悩ましい問題です。以前、知事選でもできるんじゃないかと思いまして、全国にある総支局との連携も検討したんですけれど、日々選挙取材をしている中で進めるのがハードルが高かったということがあります。なので、全社的に取り組むという環境を整えていくことが重要だと思っております。

古田:統一地方選については、私も全国のメディアの方々と話をしています。どうにもできないんじゃないかと懸念しています。我々、東京にいると、どうしても全国でどういう情報が拡散しているか掴むのが遅れる。なので、各地域のメディアの方々に頑張っていただく必要があると思います。

ただ、連携を取ろうとすると、工藤さんもおっしゃったように時間がかかる。個々が悩ましいです。

「知のアウトソーシング」への危機感

古田:それでは最後に一言ずつ。まずは越前さんお願いします。

越前:古田さんの講演に出た「プレバンキング」とか「リテラシー」について、教えるにしても教養とか知識が必要ですよね。ただ、現状の子供たちは中長期的に見ると、AIに知をアウトソースしているような状況になってきていて、判断できないんじゃないかと思うんです。

最終的に色々な情報があって判断するのは人なんですけれど、その判断するための知識がなくなるとどうなるのか気にしています。文章生成でも何でも知をAIにアウトソースして出てきたものに対し、何も考えずにそのまま出しちゃうところが非常に問題になっている。

もう一点、こうしたAIに頼ることは、経済安全保障の問題で言うと、トランプさんが「関税じゃなくてAIのAPI全部止めます」、ということもあるんじゃないかと思っています。そうした時に国産のAIモデルを作るのは極めて大事だということです。

教育的な問題とAIの国産モデル、ソブリンAIとも言いますけれど、そうしたことの重要性は今後増してくるんじゃないかと思っております。

陣内:継続性をどうやって確保していくか。そして、選挙以外の時どういう活動をしていくかが非常に重要だと思ってます。私どもは選挙の時、これまでも取り組みしてきましたけれど、それ以外に毎月だとか毎週どういうコミュニティノートがあるのかといったような情報を出していくとか、他にできることはあると考えています。

継続性に関しては、お金の問題もあるんですけれど、それ以前に使ってもらうのが前提としてあるので、特にこの1年間、報道機関だとか専門家の方々と連携して、できるだけ使っていくユーザーを増やしていく。私たちが台湾とか韓国とかと違うのは、他にビジネスをやっているので、ある程度使われて社会的意義があるんだったら、最悪、他で稼げばいいじゃないという話もある。

マネタイズもですけれど、まずは使ってもらうところにフォーカスして、持続的な活動をしていきたいと思っております。

工藤:4社協力で言いますと、昨年6月から始まり、とりあえず1年やってみようという話だったんですけれど、今年の6月以降も継続して進めていくことがほぼ固まりました。先ほど言った統一地方選や、その先の参院選に向けてまた積極的に取り組んでいきたいと思っております。

問題意識として持っているのは、報道機関の情報に接触することが世の中的に減少傾向にある一方、SNSに触れる機会は増えている。テレビや新聞を見てくれている層は、比較的偽誤情報に対する耐性が強いと思っている一方、本当にアプローチしたいのは耐性がなくて混乱させられてしまう層です。

メディアからそういうところへのアプローチが現状では難しい部分があるという問題意識を持っています。なので、報道機関としては引き続き一次情報であるとか、信頼できる情報を丹念に取材して正確性のある情報を発信していくことを考えているんですけれど、それをどう広げていくかということを日々考えて取り組んでいきたいと思います。

古田:みなさんのお話に連携とか協力みたいな言葉がありました。他国の事例を見ると、例えばフィリピンだったら「FactFirst」という活動であったり、インドだったら各メディアやファクトチェック機関が協力してディープフェイクを専門的に検証するチームを作るとか。それぞれの国に、組織を超えた連携が出来上がっている。そういったものが日本でも必要だと思っております。

最後に一つだけ。越前さんも触れていただいた、AIへの知のアウトソーシングは本質的に非常に危険な問題だと思っております。AIとは単なる技術ではなく、新たな形をした帝国だという指摘が出てきております。私たちは簡単に自分たちの自由や認知能力を奪われかねない。そういった危機感も持ちつつ、AIという便利なツールを活用し、問題点を指摘していく必要があると思っております。

情報インテグリティシンポ「パネル討論1」動画

判定基準などはJFCファクトチェック指針をご参照ください。

毎週、ファクトチェック情報をまとめて届けるニュースレター登録(無料)は、上のボタンから。また、QRコード(またはこのリンク)からLINEでJFCをフォローし、気になる情報を質問すると、AIが関連性の高いJFC記事をお届けします。詳しくはこちら。